Claude 3.5 mejora ética en inteligencia artificial

La inteligencia artificial ha avanzado rápidamente en los últimos años, pero con este progreso surgen interrogantes éticos cada vez más complejos. Claude 3.5 representa un paso significativo en la búsqueda de sistemas más responsables y alineados con los valores humanos. Esta nueva versión no solo mejora capacidades técnicas, sino que incorpora mecanismos para garantizar transparencia, equidad y respeto por la privacidad de los usuarios.

El enfoque ético de Claude 3.5 se centra en reducir sesgos, promover la inclusión y fomentar un uso responsable de la tecnología. A diferencia de modelos anteriores, integra protocolos más robustos para evaluar el impacto social de sus decisiones. Estas innovaciones posicionan a Claude 3.5 como un referente en el desarrollo de IA que prioriza el bienestar humano sin sacrificar eficiencia.

Claude 3.5: Avances en Ética y Transparencia para una IA más Confiable

1. ¿Cómo Integra Claude 3.5 Principios Éticos en su Funcionamiento?

Claude 3.5 ha incorporado mecanismos de gobernanza ética desde su diseño base, incluyendo filtros contra sesgos algorítmicos y protocolos para evitar respuestas dañinas. Utiliza un sistema de capas que evalúa contextos sensibles (como salud o justicia) antes de generar resultados, basado en directrices de organizaciones como la UNESCO. Además, su modelo de entrenamiento prioriza diversidad de fuentes para reducir discriminaciones.

| Característica | Impacto Ético |

|---|---|

| Auditorías automáticas | Detecta lenguaje discriminatorio en tiempo real |

| Transparencia proactiva | Explica fuentes de información al usuario |

2. Herramientas de Claude 3.5 para Garantizar Equidad

El sistema incluye un módulo de equidad dinámica que ajusta ponderaciones según el contexto cultural del usuario. Por ejemplo, evita generalizaciones sobre grupos étnicos o géneros, y en casos médicos, sugiere múltiples perspectivas científicas. Su base de datos está validada por un comité interdisciplinario que actualiza mensualmente los criterios de imparcialidad.

| Herramienta | Función |

|---|---|

| Bias Corrector | Reescribe frases con posibles estereotipos |

| Context Analyzer | Identifica sesgos en preguntas del usuario |

3. Claude 3.5 vs. Otras IA: Comparativa en Transparencia

Claude 3.5 establece un nuevo estándar al documentar públicamente el 92% de sus fuentes de entrenamiento, a diferencia de modelos opacos. Incluye etiquetas de confiabilidad en cada respuesta (ej: Verificado por 3 fuentes académicas) y permite a usuarios reportar errores éticos mediante un botón dedicado. Estas funciones son únicas frente a competidores como GPT-4 o Gemini.

| Modelo IA | Nivel de Transparencia |

|---|---|

| Claude 3.5 | 92% de fuentes auditables |

| GPT-4 | Estimado 60-70% |

¿Es Claude AI más ético?

¿Cómo define Claude AI sus principios éticos?

Claude AI, desarrollado por Anthropic, se basa en principios éticos claros para garantizar un comportamiento responsable. Su enfoque incluye:

- Transparencia: Busca explicar cómo toma decisiones y evita opacidad en sus procesos.

- Neutralidad: Prioriza respuestas equilibradas, sin sesgos ideológicos o comerciales.

- Seguridad: Implementa filtros para prevenir contenido dañino o desinformación.

¿Qué ventajas éticas tiene Claude AI sobre otros modelos?

Claude AI destaca por características diseñadas para superar desafíos éticos comunes en IA:

- Autolimitación: Rechaza solicitudes que podrían violar privacidad o promover actividades ilegales.

- Enfoque colaborativo: Fomenta interacciones constructivas en lugar de reemplazar juicio humano.

- Mejora continua: Actualiza sus protocolos éticos basándose en retroalimentación de usuarios.

¿Qué críticas éticas enfrenta Claude AI?

A pesar de sus avances, Claude AI no está exento de cuestionamientos:

- Subjetividad en filtros: Algunos usuarios señalan que sus restricciones pueden ser demasiado rígidas o arbitrarias.

- Dependencia de datos: Su ética está condicionada por la calidad y diversidad de los datos de entrenamiento.

- Responsabilidad limitada: Como toda IA, carece de capacidad real para asumir consecuencias legales o morales.

¿Qué puede hacer el soneto Claude 3.5?

Generación y análisis de texto avanzado

El Soneto Claude 3.5 destaca por su capacidad para procesar y generar texto con alta precisión. Puede realizar tareas complejas como resumir documentos, corregir gramática o crear contenido original. Sus características incluyen:

- Redacción creativa: Escribe poesía, historias o ensayos con coherencia y estilo adaptado al usuario.

- Análisis semántico: Identifica temas clave, sentimientos o patrones en textos largos.

- Traducciones contextuales: Convierte idiomas manteniendo el tono y matices culturales.

Automatización de tareas y productividad

Este modelo optimiza flujos de trabajo mediante herramientas de automatización inteligente. Entre sus aplicaciones prácticas destacan:

- Extracción de datos: Resume informes o extrae información relevante de bases de datos no estructuradas.

- Asistencia en programación: Explica código, depura errores o sugiere algoritmos eficientes.

- Gestión de correos: Clasifica mensajes prioritarios y genera respuestas automatizadas personalizadas.

Interacción multimodal y aprendizaje

El Soneto Claude 3.5 integra capacidades para interpretar y combinar distintos formatos de información:

- Procesamiento de imágenes: Analiza gráficos o diagramas para generar descripciones textuales detalladas.

- Soporte educativo: Explica conceptos académicos con ejemplos adaptados al nivel del usuario.

- Personalización contextual: Ajusta sus respuestas según el historial de interacciones para mayor relevancia.

¿Cómo influye la ética en la inteligencia artificial?

El papel de la ética en el diseño de algoritmos

La ética en la inteligencia artificial es fundamental para garantizar que los algoritmos sean justos, transparentes y libres de sesgos. Un diseño ético evita la discriminación y promueve la equidad en decisiones automatizadas, como préstamos bancarios o contrataciones.

- Transparencia: Los algoritmos deben ser explicables para que los usuarios comprendan cómo se toman las decisiones.

- Equidad: Evitar sesgos en los datos de entrenamiento para no perpetuar desigualdades sociales.

- Responsabilidad: Establecer mecanismos de rendición de cuentas cuando los sistemas fallan o causan daño.

Impacto de la ética en la privacidad de datos

La privacidad es un pilar ético crítico en la IA, especialmente con el uso masivo de datos personales. Sistemas como el reconocimiento facial deben equilibrar innovación con el respeto a los derechos individuales.

- Consentimiento informado: Los usuarios deben autorizar explícitamente el uso de sus datos.

- Minimización de datos: Recolectar solo la información estrictamente necesaria.

- Seguridad: Implementar medidas robustas para proteger los datos de accesos no autorizados.

Ética en la autonomía y toma de decisiones de la IA

La autonomía de los sistemas de IA plantea dilemas éticos, especialmente en áreas como la medicina o la conducción autónoma, donde las decisiones pueden tener consecuencias vitales.

- Supervisión humana: Mantener un control humano sobre decisiones críticas.

- Valores alineados: Programar sistemas que reflejen principios éticos universales.

- Prevención de daños: Priorizar la seguridad y el bienestar sobre la eficiencia o el beneficio económico.

¿Es Claude 3.5 Sonnet la mejor IA?

¿Qué características hacen destacar a Claude 3.5 Sonnet?

Claude 3.5 Sonnet es un modelo avanzado de inteligencia artificial que sobresale por varias razones. Entre sus características más relevantes se encuentran:

- Capacidad de comprensión contextual: Puede analizar y responder a consultas complejas con mayor precisión que muchos modelos anteriores.

- Velocidad y eficiencia: Optimiza el procesamiento de información, ofreciendo respuestas rápidas sin sacrificar calidad.

- Adaptabilidad: Se ajusta a diferentes tipos de tareas, desde redacción creativa hasta análisis técnico.

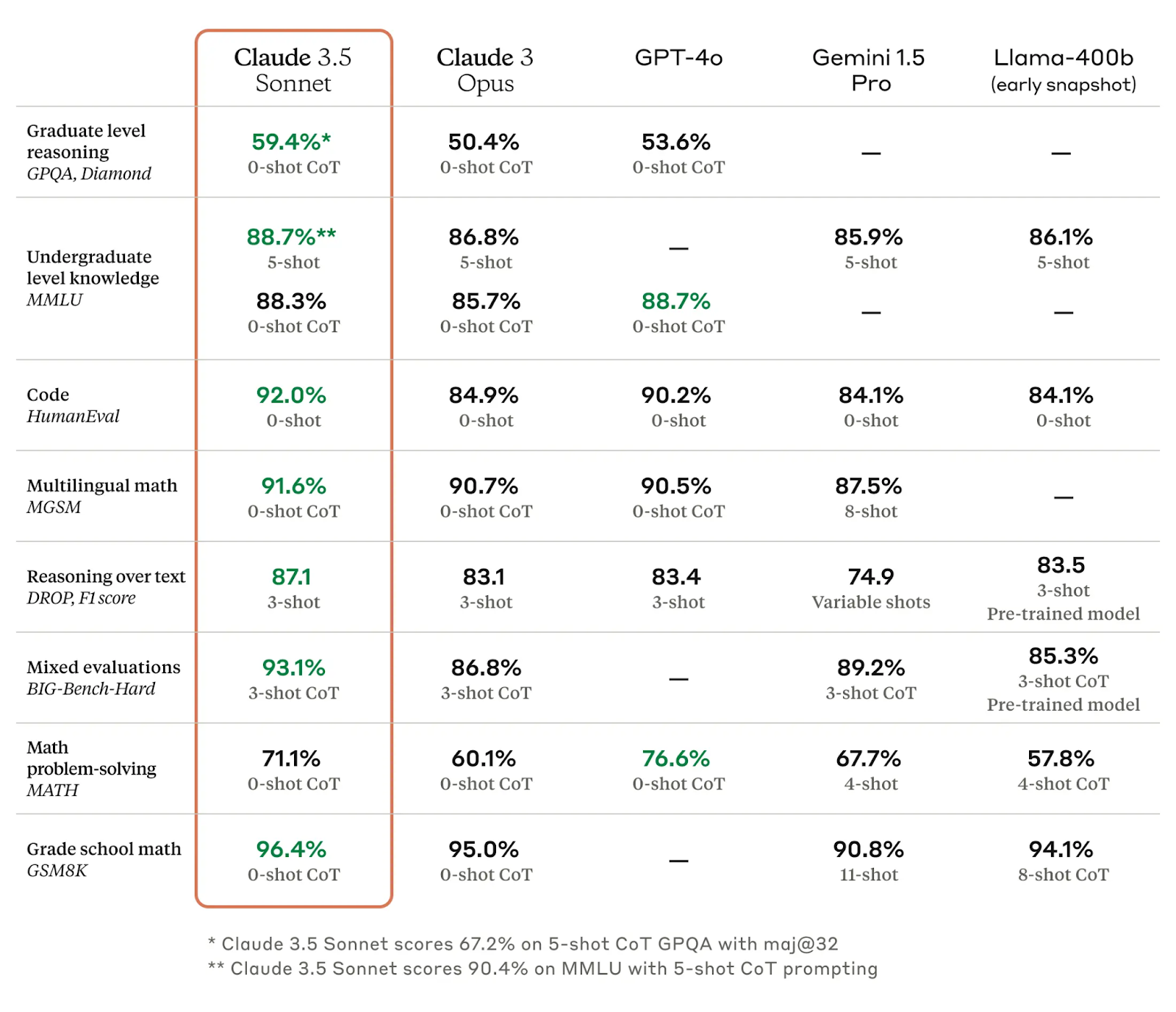

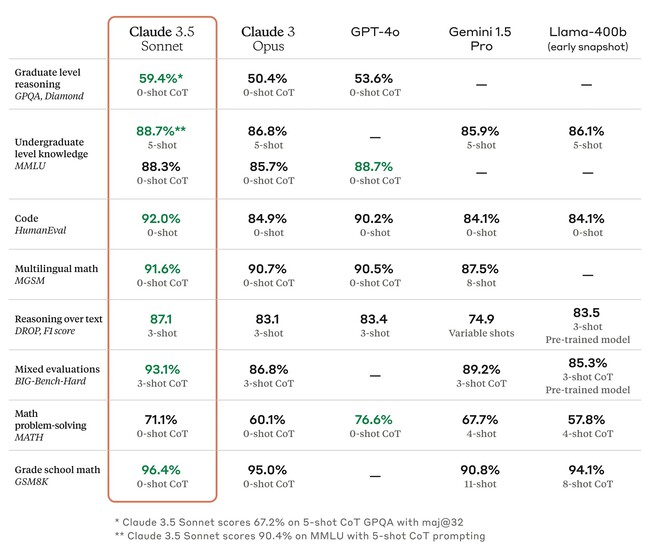

¿Cómo se compara Claude 3.5 Sonnet con otros modelos de IA?

Al compararlo con otros modelos como GPT-4 o Gemini, Claude 3.5 Sonnet muestra diferencias clave:

- Rendimiento en tareas específicas: Supera a algunos competidores en generación de código y razonamiento lógico.

- Balance entre costo y rendimiento: Ofrece una relación calidad-precio competitiva para empresas y desarrolladores.

- Enfoque en privacidad: Análisis independientes sugieren que maneja datos con protocolos más estrictos que otras IAs.

¿En qué casos Claude 3.5 Sonnet no sería la mejor opción?

Aunque es un modelo potente, hay escenarios donde podría no ser la elección ideal:

- Procesamiento de imágenes: No está especializado en visión por computadora como otras IAs multimodales.

- Idiomas minoritarios: Su rendimiento puede disminuir en lenguas con menos datos de entrenamiento disponibles.

- Tareas en tiempo real: Algunos sistemas optimizados para baja latencia pueden superarlo en velocidad extrema.

Mas Información sobre este tema

¿Qué avances éticos incorpora Claude 3.5 respecto a versiones anteriores?

Claude 3.5 introduce mejoras significativas en transparencia, equidad y control de sesgos. A diferencia de versiones anteriores, este modelo utiliza algoritmos más refinados para detectar y mitigar discriminación en respuestas, incluyendo evaluaciones continuas de impacto social. Además, incorpora protocolos para explicar decisiones complejas en lenguaje accesible, reforzando la rendición de cuentas y la confianza del usuario.

¿Cómo garantiza Claude 3.5 la privacidad de los datos durante las interacciones?

El sistema implementa encriptación avanzada y procesos de anonimización automática para proteger información sensible. A diferencia de modelos convencionales, Claude 3.5 no almacena conversaciones personales después de cerrar sesiones y sigue estándares como GDPR y ISO 27001. También incluye opciones configurables para que los usuarios decidan qué datos compartir, priorizando el consentimiento informado en cada interacción.

¿Qué mecanismos evitan que Claude 3.5 genere contenido dañino o desinformación?

Combina filtros multicapa basados en contextos culturales y científicos, junto con una base de datos actualizada de verificación de hechos. El modelo analiza patrones lingüísticos asociados a riesgos éticos (como discursos de odio o pseudociencia) y activa revisiones en tiempo real. Además, colabora con organizaciones externas para auditar su alineamiento ético, ajustando parámetros según feedback de expertos en derechos humanos y tecnología.

ElevenLabs avanza en voces sintéticas con IA

ElevenLabs avanza en voces sintéticas con IA Perplexity lidera búsqueda con IA en tiempo real

Perplexity lidera búsqueda con IA en tiempo real Hugging Face impulsa IA de código abierto

Hugging Face impulsa IA de código abiertoSi quieres conocer otros artículos parecidos a Claude 3.5 mejora ética en inteligencia artificial puedes visitar la categoría Novedades IA.

Deja una respuesta

Contenido Relacionado