BentoML deploya modelos de IA en producción

BentoML deploya modelos de IA en producción, en el mundo actual, donde la inteligencia artificial (IA) se ha convertido en un pilar fundamental para diversas industrias, desplegar modelos de manera eficiente y escalable es un desafío constante. BentoML surge como una solución robusta diseñada para simplificar este proceso, permitiendo a los equipos de ciencia de datos y desarrollo llevar sus modelos desde la fase experimental hasta entornos de producción con facilidad. Su enfoque flexible y orientado a la productividad lo convierte en una herramienta clave para organizaciones que buscan maximizar el valor de sus inversiones en IA.

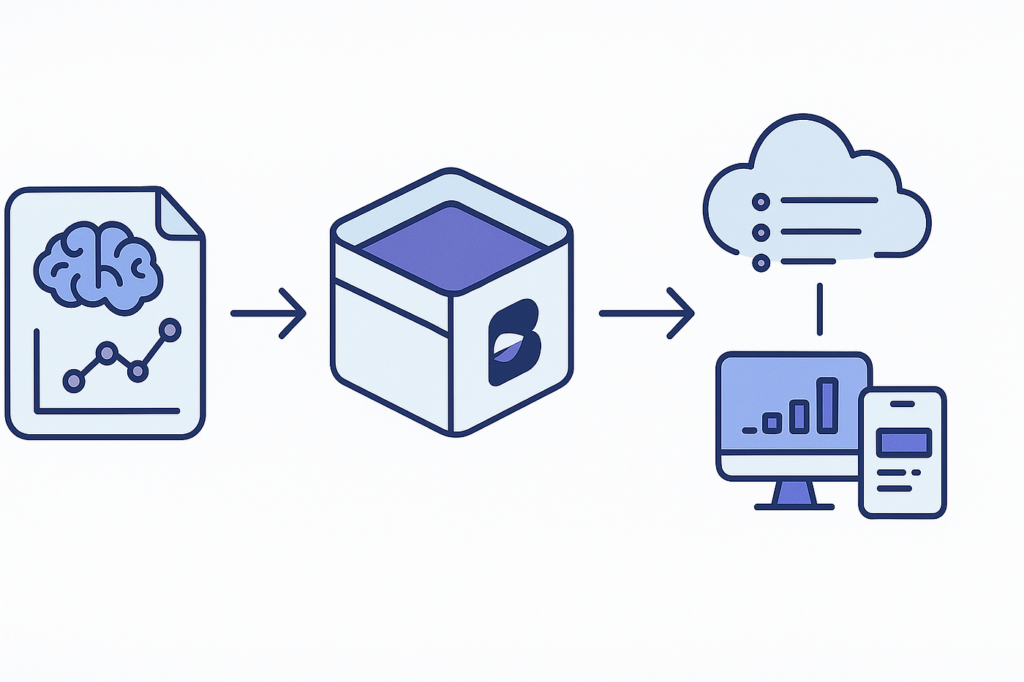

Con BentoML, los usuarios pueden empaquetar, versionar y desplegar modelos de aprendizaje automático en diferentes plataformas, desde la nube hasta entornos locales. Su arquitectura modular y su integración con tecnologías populares facilitan la implementación de pipelines de IA sin sacrificar rendimiento o escalabilidad. Este artículo explora cómo BentoML optimiza el despliegue de modelos, reduciendo la brecha entre el desarrollo y la producción para acelerar la entrega de soluciones basadas en IA.

Te puede interesar leer: Outwrite AI corrige textos con IA moderna

¿Cómo BentoML simplifica el despliegue de modelos de IA en producción?

1. Ventajas de usar BentoML para despliegue de IA

BentoML es una herramienta diseñada para agilizar el proceso de llevar modelos de aprendizaje automático a entornos de producción. Su principal ventaja es la capacidad de empaquetar modelos, dependencias y lógica de servicio en un contenedor reproducible y escalable. Esto elimina los problemas de compatibilidad entre entornos de desarrollo y producción. Además, BentoML soporta múltiples frameworks como TensorFlow, PyTorch y scikit-learn, lo que lo hace versátil para diferentes proyectos de IA.

| Característica | Beneficio |

|---|---|

| Empaquetado automático | Simplifica la transición de desarrollo a producción |

| Soporte multi-framework | Compatibilidad con diversas bibliotecas de IA |

| Escalabilidad integrada | Preparado para manejar cargas de trabajo variables |

2. Flujo de trabajo con BentoML para despliegue

El proceso de despliegue sigue un flujo estandarizado que garantiza consistencia. Primero se guarda el modelo entrenado en el formato, luego se define un servicio API alrededor del modelo y finalmente se genera un paquete listo para implementar. Este paquete puede desplegarse en diversas plataformas como Kubernetes, AWS Lambda o directamente como servicio web. La herramienta también proporciona monitoreo básico del modelo en producción.

| Paso | Descripción |

|---|---|

| Guardado del modelo | Serialización del modelo en formato BentoML |

| Definición de servicio | Creación de API para interacción con el modelo |

| Generación de paquete | Creación de artefacto desplegable (Bento) |

3. Escenarios de implementación con BentoML

Ofrece flexibilidad para diferentes necesidades de implementación. Desde microservicios ligeros hasta sistemas distribuidos complejos, la herramienta se adapta a diversos requisitos de infraestructura. Es particularmente útil para equipos que necesitan implementar actualizaciones frecuentes de modelos sin tiempos de inactividad significativos. También facilita las pruebas A/B de diferentes versiones de modelos en producción.

| Escenario | Uso de BentoML |

|---|---|

| Implementación en la nube | Despliegue rápido en AWS, GCP o Azure |

| Edge computing | Paquetes optimizados para dispositivos periféricos |

| Arquitecturas híbridas | Compatibilidad con entornos mixtos |

Mas Información sobre este tema

¿Qué es BentoML y cómo facilita el despliegue de modelos de IA en producción?

Es un marco de trabajo de código abierto diseñado para empaquetar, implementar y escalar modelos de aprendizaje automático en entornos de producción. Su principal ventaja radica en su capacidad para convertir modelos entrenados en servicios API listos para usar, independientemente del framework de IA utilizado (como TensorFlow, PyTorch o Scikit-learn). Además, BentoML simplifica la integración con plataformas de despliegue como Kubernetes, Docker o servicios en la nube, reduciendo la complejidad operativa y acelerando el tiempo de implementación.

¿Cuáles son los beneficios clave de usar BentoML para despliegue de modelos?

Entre los beneficios más destacados se encuentran su flexibilidad para trabajar con múltiples frameworks de IA, su capacidad para generar contenedores Docker optimizados automáticamente y su sistema de versionado de modelos, que permite rastrear cambios y revertir actualizaciones si es necesario. Además, ofrece monitoreo integrado y escalabilidad horizontal, lo que lo hace ideal para entornos de producción con demandas variables. Su enfoque en estandarización también reduce los errores humanos durante la implementación.

¿Cómo se compara BentoML con otras soluciones de despliegue de IA como MLflow o Seldon Core?

Mientras que MLflow se centra más en el ciclo de vida experimental del modelo (seguimiento de experimentos, registro), este específicamente optimizado para la fase de producción, ofreciendo un rendimiento superior en entornos de alto tráfico. En comparación con Seldon Core, BentoML destaca por su sencillez de configuración y su enfoque en la creación de APIs REST/gRPC sin necesidad de complejas personalizaciones. Sin embargo, BentoML puede integrarse con estas herramientas, combinando lo mejor de ambos mundos: gobernanza de modelos (MLflow) y orquestación avanzada (Seldon).

Esto es de tu interes MLflow Models gestiona despliegue de IA

MLflow Models gestiona despliegue de IA TensorFlow entrena modelos de IA para desarrolladores

TensorFlow entrena modelos de IA para desarrolladores PyTorch crea redes neuronales con IA fácilmente

PyTorch crea redes neuronales con IA fácilmenteSi quieres conocer otros artículos parecidos a BentoML deploya modelos de IA en producción puedes visitar la categoría IA para Desarrolladores.

Deja una respuesta

Contenido Relacionado