BigDL usa IA para big data en Apache Spark

En el mundo del big data, procesar grandes volúmenes de información de manera eficiente es un desafío constante. Aquí es donde BigDL, una biblioteca de aprendizaje profundo de código abierto, marca la diferencia al integrarse con Apache Spark. Esta combinación permite ejecutar modelos de inteligencia artificial directamente en entornos distribuidos, optimizando el análisis de datos a gran escala.

BigDL está diseñado para simplificar el despliegue de IA en infraestructuras existentes sin requerir cambios significativos. Al aprovechar las capacidades de Spark, facilita el entrenamiento y la inferencia de modelos complejos, incluso en clusters convencionales. Esta herramienta se posiciona como una solución accesible para empresas que buscan escalar sus aplicaciones de machine learning sin sacrificar rendimiento ni flexibilidad.

Te puede interesar leer: Zoho Desk optimiza soporte con IA moderna

BigDL: Integración de IA y Big Data en Apache Spark

BigDL es una biblioteca de aprendizaje profundo diseñada específicamente para trabajar con grandes volúmenes de datos en Apache Spark. Esta herramienta permite a los desarrolladores y científicos de datos implementar modelos de inteligencia artificial directamente en entornos distribuidos, optimizando el procesamiento de big data. La combinación de BigDL con Spark facilita el entrenamiento y despliegue de modelos de IA a escala, sin necesidad de migrar datos a otras plataformas.

¿Cómo funciona BigDL en Apache Spark?

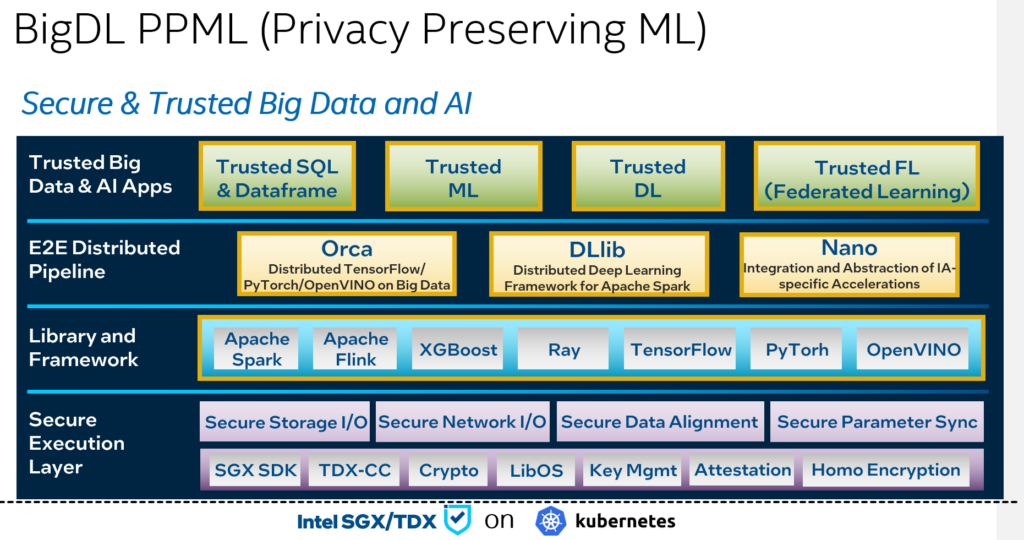

BigDL se integra nativamente con Apache Spark, aprovechando su arquitectura distribuida para procesar datos masivos. Utiliza las capacidades de Spark para paralelizar tareas de entrenamiento de modelos de deep learning, lo que reduce significativamente el tiempo de procesamiento. Además, BigDL soporta frameworks populares como TensorFlow y PyTorch, permitiendo una transición fluida entre herramientas.

| Característica | Beneficio |

|---|---|

| Integración con Spark | Procesamiento distribuido eficiente |

| Soporte para TensorFlow/PyTorch | Compatibilidad con frameworks conocidos |

| Escalabilidad horizontal | Manejo de datasets masivos |

Ventajas de usar BigDL para IA en Big Data

La principal ventaja de BigDL radica en su capacidad para unificar el ecosistema de big data con el aprendizaje profundo. Elimina la necesidad de sistemas separados para almacenamiento y modelado, reduciendo la complejidad y los costos operativos. También ofrece optimizaciones automáticas para hardware, mejorando el rendimiento en clústeres de Spark.

| Ventaja | Impacto |

|---|---|

| Unificación de infraestructura | Simplifica la arquitectura de datos |

| Optimizaciones de hardware | Mayor eficiencia computacional |

| Reducción de costos | Elimina sistemas redundantes |

Casos de uso prácticos de BigDL

BigDL es utilizado en diversas industrias para resolver problemas complejos de big data con IA. En el sector financiero, se emplea para detección de fraudes en tiempo real. Las empresas de retail lo usan para análisis de comportamiento de clientes, mientras que en telecomunicaciones ayuda a optimizar redes mediante aprendizaje automático.

| Industria | Aplicación |

|---|---|

| Finanzas | Detección de fraudes |

| Retail | Análisis de clientes |

| Telecomunicaciones | Optimización de redes |

¿Se utiliza Spark para Big Data?

¿Qué es Apache Spark y por qué se usa en Big Data?

Apache Spark es un motor de procesamiento distribuido diseñado para manejar grandes volúmenes de datos de manera eficiente. Se utiliza en Big Data debido a su capacidad para procesar información en tiempo real y ejecutar operaciones complejas a gran escala. A continuación, sus ventajas clave:

- Velocidad: Spark procesa datos en memoria, lo que reduce los tiempos de ejecución comparado con herramientas como Hadoop MapReduce.

- Escalabilidad: Puede manejar desde gigabytes hasta petabytes de datos distribuidos en clusters.

- Versatilidad: Soporta múltiples lenguajes (Scala, Python, Java, R) y bibliotecas para SQL, machine learning y grafos.

¿Cómo funciona Spark en entornos de Big Data?

Spark opera bajo un modelo de procesamiento en memoria, evitando accesos repetidos al almacenamiento externo. Su arquitectura se basa en RDDs (Resilient Distributed Datasets) y DataFrames para gestionar datos. Detalles clave:

- Distribución de datos: Divide los datos en particiones que se procesan en paralelo en nodos del cluster.

- Tolerancia a fallos: Reconstruye automáticamente datos perdidos gracias a los RDDs inmutables.

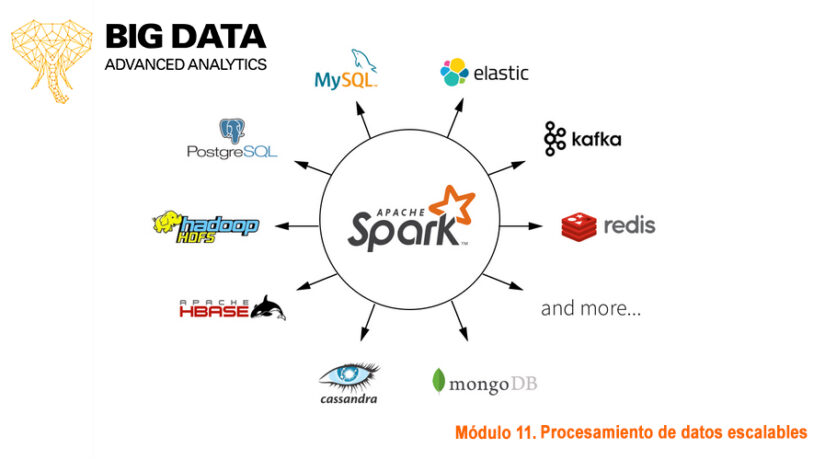

- Integración: Funciona con sistemas como HDFS, Kafka o Amazon S3 para ingestar datos.

Casos de uso de Spark en Big Data

Spark es ideal para aplicaciones que requieren análisis avanzado o baja latencia. Algunos ejemplos comunes:

- Procesamiento de streams: Análisis de datos en tiempo real (ej. transacciones financieras o redes sociales).

- Machine Learning: Entrenamiento de modelos con bibliotecas como MLlib.

- ETL: Transformación y carga de grandes conjuntos de datos para almacenes como Data Lakes.

¿Qué es big data Spark?

¿Qué es Apache Spark en el contexto de Big Data?

Apache Spark es un framework de procesamiento distribuido diseñado para manejar grandes volúmenes de datos (Big Data) de manera eficiente. A diferencia de herramientas tradicionales como Hadoop MapReduce, Spark ejecuta operaciones en memoria RAM, lo que acelera el procesamiento hasta 100 veces más rápido. Está optimizado para tareas como:

- Análisis de datos en tiempo real (streaming).

- Procesamiento por lotes (batch processing).

- Machine Learning mediante su biblioteca MLlib.

¿Cómo funciona Spark en entornos de Big Data?

Spark opera mediante un modelo de ejecución en clúster, donde divide las tareas en nodos para procesamiento paralelo. Su arquitectura se compone de:

- Driver Program: Coordina las tareas y distribuye el código.

- Cluster Manager (como YARN o Mesos): Asigna recursos.

- Executors: Ejecutan las operaciones en los nodos.

Ventajas clave de usar Spark para Big Data

Spark destaca por su velocidad, flexibilidad y escalabilidad, siendo ideal para proyectos de Big Data. Sus principales beneficios incluyen:

- Lenguajes múltiples: Soporta Scala, Java, Python y R.

- Bibliotecas integradas: Spark SQL, GraphX y Spark Streaming.

- Tolerancia a fallos: Recupera datos automáticamente mediante RDDs.

¿Para qué se utiliza Apache Spark?

Procesamiento de grandes volúmenes de datos

Apache Spark se utiliza principalmente para el procesamiento distribuido de grandes conjuntos de datos. Su arquitectura permite manejar información a escala masiva, optimizando el rendimiento mediante el uso de memoria RAM y técnicas de procesamiento en paralelo.

- Análisis de datos: Ideal para ejecutar consultas complejas sobre petabytes de información.

- Transformaciones ETL: Facilita la extracción, transformación y carga de datos en sistemas de almacenamiento.

- Batch processing: Procesa lotes de datos de manera eficiente, reduciendo tiempos de ejecución.

Machine Learning y análisis avanzado

Spark incluye bibliotecas como MLlib para desarrollar modelos de machine learning y algoritmos de análisis predictivo. Su capacidad para trabajar con datos en tiempo real lo hace ideal para aplicaciones de IA.

- Entrenamiento de modelos: Distribuye el cálculo de algoritmos sobre clusters.

- Recomendaciones en tiempo real: Usado en plataformas de e-commerce o streaming.

- Procesamiento de lenguaje natural (NLP): Analiza texto a gran escala con herramientas integradas.

Procesamiento de flujos de datos (Streaming)

Con Spark Streaming, la plataforma permite procesar datos en tiempo real, como transacciones financieras o logs de servidores, utilizando micro-lotes para garantizar baja latencia.

- Monitoreo de eventos: Detecta anomalías en flujos continuos de información.

- Actualizaciones de dashboards: Proporciona visualizaciones en tiempo real.

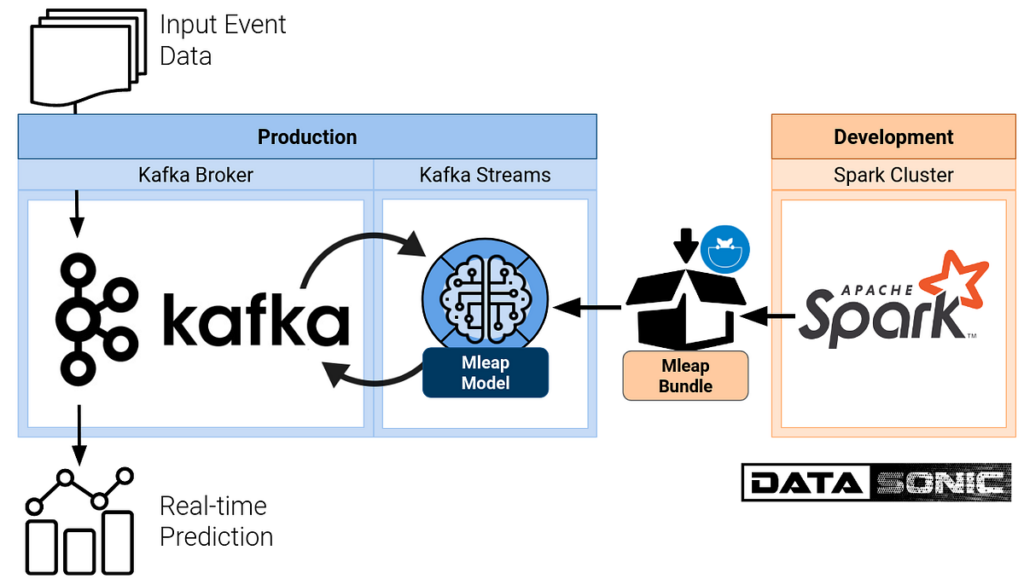

- Integración con Kafka: Conecta fuentes de streaming externas para procesamiento inmediato.

¿Qué es el spark?

¿Qué es Apache Spark?

Apache Spark es un framework de procesamiento de datos de código abierto diseñado para manejar grandes volúmenes de información de manera rápida y distribuida. A diferencia de sistemas tradicionales como Hadoop, Spark opera en memoria, lo que le permite ejecutar tareas hasta 100 veces más rápido. Es compatible con múltiples lenguajes de programación, como Python, Java y Scala, y se utiliza en aplicaciones de análisis en tiempo real, machine learning y procesamiento de datos batch.

- Arquitectura distribuida: Divide el trabajo en nodos para procesar datos en paralelo.

- Resistencia a fallos: Recupera automáticamente datos perdidos gracias a su modelo de RDDs (Resilient Distributed Datasets).

- Integración flexible: Funciona con sistemas como Hadoop, Kubernetes y bases de datos como PostgreSQL.

¿Cómo funciona Spark?

El funcionamiento de Spark se basa en un motor de ejecución en memoria que optimiza las operaciones mediante un DAG (Gráfico Acíclico Dirigido). Este gráfico permite planificar tareas de manera eficiente, minimizando la escritura en disco. Spark también utiliza un coordinador maestro (Driver) que distribuye las tareas a los ejecutores (Workers) en un clúster.

- Driver Program: Coordina la ejecución de aplicaciones y define las transformaciones de datos.

- Cluster Manager: Asigna recursos (como YARN o Mesos) para gestionar los nodos.

- Ejecutores: Procesan las tareas asignadas y almacenan datos en memoria o disco.

Ventajas de usar Spark

Spark destaca por su velocidad, escalabilidad y versatilidad, lo que lo hace ideal para entornos de big data. Su capacidad para manejar flujos de datos en tiempo real (Spark Streaming) y su integración con bibliotecas como MLlib (machine learning) o GraphX (procesamiento de grafos) amplían sus casos de uso.

- Rendimiento superior: Minimiza la latencia al evitar el acceso frecuente a disco.

- API unificada: Ofrece interfaces consistentes para SQL, streaming y análisis complejos.

- Ecosistema robusto: Incluye herramientas para ETL, inteligencia artificial y visualización.

Mas Información sobre este tema

¿Qué es BigDL y cómo utiliza la IA para big data en Apache Spark?

BigDL es una biblioteca de aprendizaje profundo distribuido diseñada específicamente para trabajar con grandes volúmenes de datos en Apache Spark. Utiliza técnicas de inteligencia artificial y machine learning para procesar y analizar datos a gran escala directamente en entornos Spark, sin necesidad de migrar a otras plataformas. Esto permite a los usuarios aprovechar la infraestructura existente de Spark para entrenar modelos complejos de IA de manera eficiente, reduciendo costos y simplificando el flujo de trabajo en proyectos de big data.

¿Cuáles son las ventajas de usar BigDL frente a otras herramientas de IA para big data?

Una de las principales ventajas de BigDL es su integración nativa con Apache Spark, lo que elimina la necesidad de sistemas externos para el procesamiento de datos. Además, ofrece escalabilidad horizontal, permitiendo distribuir cargas de trabajo de IA en clusters de Spark sin modificaciones complejas. Otra ventaja clave es su soporte para modelos de deep learning preentrenados y personalizables, optimizados para entornos distribuidos. Esto lo hace ideal para empresas que ya utilizan Spark y buscan incorporar IA sin incurrir en costos adicionales de infraestructura.

¿Qué tipos de aplicaciones pueden desarrollarse con BigDL en Apache Spark?

Con BigDL, es posible desarrollar una amplia gama de aplicaciones de inteligencia artificial en el ecosistema Spark, como sistemas de recomendación, procesamiento de lenguaje natural (NLP), visión por computadora y análisis predictivo. También es útil en sectores como finanzas para detectar fraudes, en salud para diagnóstico médico asistido por IA, o en retail para optimizar inventarios. Su capacidad para manejar datos a gran escala lo convierte en una solución versátil para industrias que requieren procesamiento rápido y preciso de información masiva.

Si quieres conocer otros artículos parecidos a BigDL usa IA para big data en Apache Spark puedes visitar la categoría IA para Desarrolladores.

Deja una respuesta

Contenido Relacionado